人工智能学习

神经网络的三个关键函数:sigmoid、ReLU和softmax函数

神经网络是一个非常有趣的研究领域,其中有许多不同的函数在其操作中发挥重要作用。在本文中,我们将探讨神经网络编程中使用的三个关键函数:sigmoid函数、ReLU函数和softmax函数。

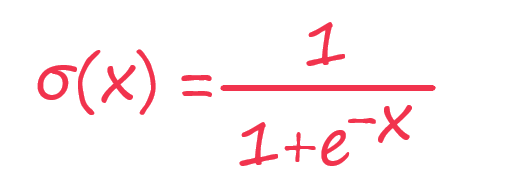

Sigmoid函数

Sigmoid函数是神经网络中常用的激活函数之一。它接受实值输入并将其映射到介于0和1之间的值,表示类似概率的输出。Sigmoid函数的数学公式如下:

在Python中,sigmoid函数的简单实现如下所示:

import math

def sigmoid(x):

return 1 / (1 + math.exp(-x))

针对于它的应用场景,举个例子:在二元分类问题中,比如判断一张图片是否包含猫,可以将sigmoid激活函数应用于神经网络的最终输出层,以产生一个表示输入图片包含猫的可能性的概率值。

ReLU函数

ReLU(修正线性单元)函数是神经网络中常用的另一种激活函数。它接受实值输入并返回输入本身(如果为正)或零(如果为负)。ReLU函数的数学公式如下:

在Python中,ReLU函数的简单实现如下所示:

def relu(x):

return max(0, x)

针对于它的应用场景,举个例子:在用于图像分类的卷积神经网络(CNN)中,可以将ReLU激活函数应用于每个卷积层的输出,以引入非线性到模型中,并帮助它从输入图像中学习更复杂的特征。

Softmax函数

Softmax函数通常用作为神经网络设计的最终激活函数,用于多类别分类问题。它接受实值向量并返回可能类别的概率分布,每个类别被指定一个介于0和1之间的概率值,总和为1。Softmax函数的数学公式如下:

在Python中,softmax函数的简单实现如下所示:

import numpy as np

def softmax(x):

e_x = np.exp(x - np.max(x))

return e_x / e_x.sum()

针对于它的应用场景,举个例子:在用于手写数字分类的神经网络中,输出层将具有10个节点,每个节点代表一个可能的数字(0-9),并且softmax激活函数将被应用于这些节点以产生一个可能的数字的概率分布。

总之,sigmoid、ReLU和softmax函数都是神经网络程序员工具箱中重要的工具。通过理解这些函数如何工作以及它们可以应用的领域,可以更好地建立有效的机器学习模型。

-

TiDB 8.5 LTS 发版——支持无限扩展,开启 AI 就绪新时代01-10

-

SaaS工具的智能升级:AI Agent赋能的潜力与应用前景01-07

-

SaaS+AI如何重新定义企业问题解决方式?01-07

-

如何利用AI看板工具提升团队协作效率?10大深度评测与实用技巧01-04

-

带有自反功能的自适应检索增强生成系统01-03

-

FAISS向量数据库在生产LLM应用中的使用指南01-03

-

掌握RAG:深入探讨文本分割技巧01-03

-

深入探究结构化输出的应用技巧01-03

-

因果推断的基本问题:现代视角下的统计挑战01-03

-

预测的艺术:预AI时代的滤波技术讲解01-03

-

OpenAI 新模型“草莓”来袭,o1-preview版本抢先看!01-03

-

利用知识图谱和大模型提升元数据管理的思考与实践(上篇)01-03

-

llama 3.1 — 技术规格和代码解析01-03

-

基于LangGraph的多代理应用开发利器01-03

-

打造自定义AI智维助手:基于Jira的自动化任务处理系统01-03